Die Woche ist rum, und es ist Zeit für einen neuen Blogbeitrag! Heute tauchen wir mal in ein aktuelles Thema ein: PimEyes und das Ende der Anonymität im Netz. Ihr kennt den Spruch „Das Internet vergisst nie“, oder? Mit dem Spruch „Das Internet vergisst nie“ sind viele vertraut. Durch Tools wie PimEyes wird es zunehmend möglich, gezielt Bilder und Spuren im Netz zu finden und nachzuverfolgen – selbst innerhalb der gigantischen Menge an täglich erzeugten digitalen Inhalten. Wie wirkt sich diese Technologie auf die Privatsphäre aus? In unserem neuesten Beitrag werfen wir einen genaueren Blick darauf und beleuchten, welche Chancen und Herausforderungen damit einhergehen.

PimEyes – Das Ende der Anonymität im Netz?

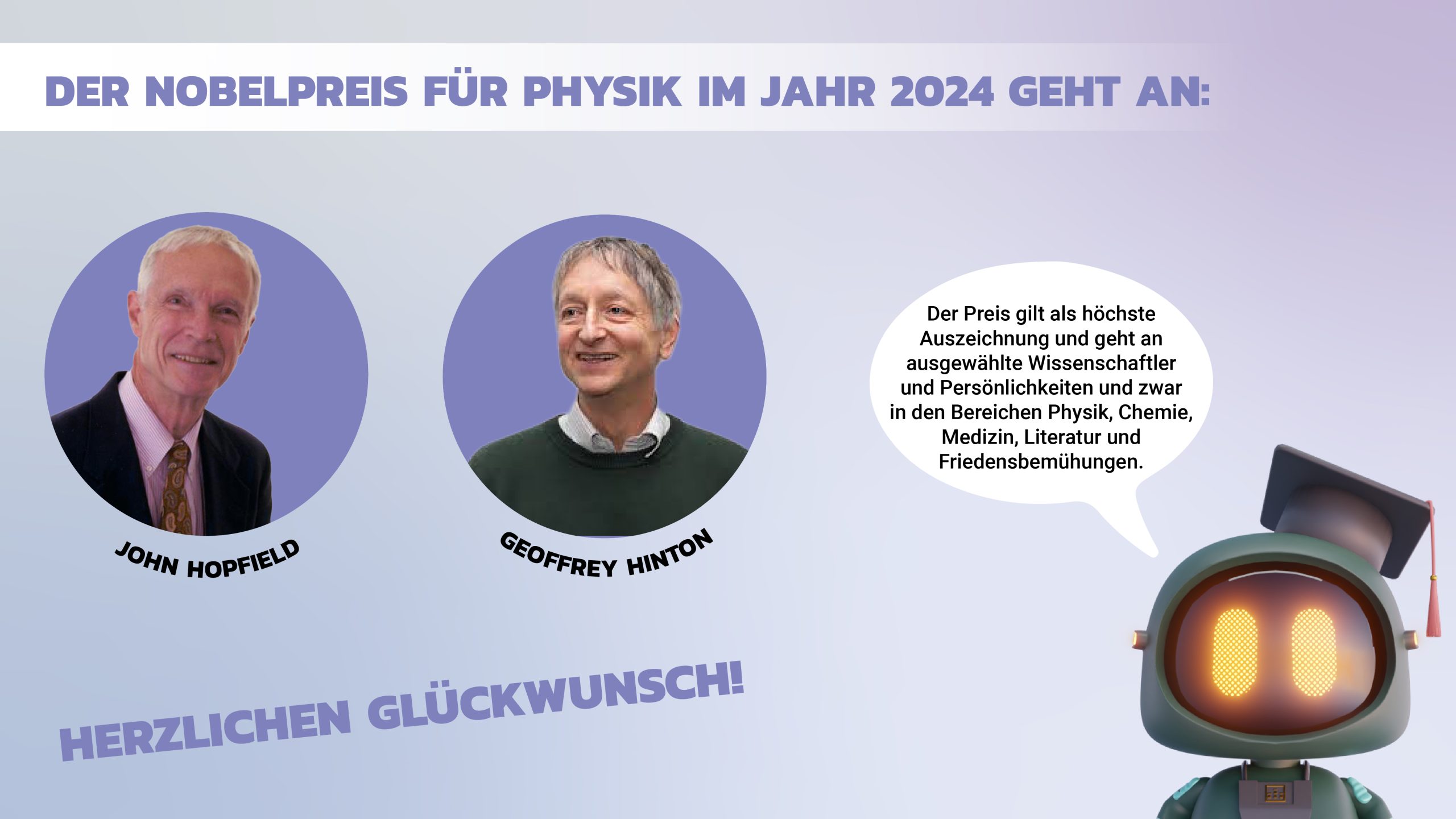

Das digitale Zeitalter hat uns nicht nur eine vernetzte Welt gebracht, sondern auch eine beunruhigende Realität: die Anonymität im Netz schwindet zunehmend. Ein Beispiel dafür ist PimEyes, eine Plattform, die durch Gesichtserkennungstechnologie jedem die Möglichkeit gibt, ein Bild hochzuladen und ähnliche Bilder online zu finden. Dieser Blogpost beleuchtet die faszinierenden, aber auch beunruhigenden Aspekte dieser Technologie.

PimEyes – Die Technologie dahinter

PimEyes funktioniert im Wesentlichen wie eine Gesichtssuchmaschine. Durch hochgeladenes Bildmaterial wird das Netz durchsucht, um ähnliche Gesichter auf Webseiten, Blogs oder in sozialen Medien zu finden. Was nach einem nützlichen Tool klingt, um die eigene Online-Präsenz zu kontrollieren, weckt ernsthafte Datenschutzbedenken.

Mit Preisen ab etwa 29,99 $ monatlich bietet PimEyes auch eine „Einmal-Suchoption“, die Nutzern für 14,99 $ Zugriff auf aktuelle Ergebnisse ermöglicht – ohne Abo. Auf diese Weise kann praktisch jeder das Internet nach Gesichtsmustern durchsuchen, sei es zur Selbstkontrolle oder – was problematisch sein kann – zur Recherche über andere Personen.

Vorteile von PimEyes

Für Einzelpersonen, die sich um ihre digitale Präsenz sorgen, kann PimEyes hilfreich sein. Es erlaubt:

– Kontrolle über Online-Bilder: Nutzer erhalten eine Übersicht, wo ihre Fotos online erscheinen und können Maßnahmen ergreifen, falls diese ungewollt oder in unangemessenem Kontext veröffentlicht wurden.

– Einfache Handhabung: Die Nutzeroberfläche ist unkompliziert, was das Tool auch für Nicht-Techniker zugänglich macht.

– Gezielte Überwachung der Privatsphäre: PimEyes könnte für Personen hilfreich sein, die gezielt nach potenziellen Missbräuchen ihrer Bilder suchen.

Schattenseiten von PimEyes

Aber die Bedenken wiegen schwer. Denn die einfache Verfügbarkeit von Gesichtserkennungstools öffnet auch Türen zu Missbrauch:

– Missbrauchsrisiken: Stalking und Identitätsdiebstahl sind potenzielle Risiken, da jeder Dritte mit einem Foto eine Person im Netz verfolgen könnte.

– Schwinden der Anonymität: Mit PimEyes wird es zunehmend unmöglich, im Internet wirklich anonym zu bleiben. Ein einziges Foto kann dazu führen, dass persönliche Informationen zugänglich werden, die nicht für die Öffentlichkeit bestimmt sind.

– Fragwürdige ethische Verantwortung: PimEyes betont, dass der Nutzer für den verantwortungsvollen Umgang mit der Technologie verantwortlich sei – eine heikle Position, die Fragen nach der Sicherheit und ethischen Grenzen aufwirft.

Wie PimEyes sich selbst positioniert

PimEyes behauptet, ein Werkzeug zur digitalen Selbstkontrolle bereitzustellen. Sie betonen, dass das Tool ethisch eingesetzt werden sollte und die Verantwortung für den Einsatz beim Nutzer liege. Außerdem wurde der Dienst in bestimmten Regionen eingeschränkt, etwa für russische Nutzer seit dem Ukraine-Krieg, um potenziellen Missbrauch weiter einzudämmen. Doch trotz dieser Sicherheitsmaßnahmen bleibt die Frage offen: Wie weit darf und sollte Technologie zur Gesichtserkennung gehen?

Schutz vor Gesichtserkennung – Was du tun kannst

Falls du dir Sorgen machst, gibt es einige Ansätze, um zumindest einen Teil deiner digitalen Privatsphäre zu bewahren:

1. Regelmäßige Überprüfung: Suche regelmäßig nach deinen eigenen Fotos im Netz, um herauszufinden, wo sie möglicherweise auftauchen.

2. Profileinstellungen anpassen: Schränke die Sichtbarkeit deiner Social-Media-Profile ein und prüfe die Privatsphäre-Einstellungen.

3. Bedachtes Teilen: Überlege gut, welche Bilder du wirklich öffentlich machen willst.

Fazit: Ein schmaler Grat zwischen Kontrolle und Datenschutzverlust

PimEyes zeigt, dass das Prinzip „das Internet vergisst nie“ heute relevanter ist als je zuvor. Die Anonymität, die viele von uns lange für selbstverständlich hielten, ist mehr Illusion als Realität. Technologien wie PimEyes helfen uns zwar, unsere Online-Spuren zu überwachen, führen aber auch zu einem erheblichen Verlust an Privatsphäre.

Die entscheidende Frage bleibt: Wie weit soll Technologie gehen, und wo ziehen wir die Grenzen? Seid euch bewusst, dass jede Online-Spur nachverfolgt werden könnte und prüft, wie und was ihr von euch im Netz hinterlasst.

Dieser Themenwunsch für den Monat Oktober kam von unserem Werkstudenten Vincent.